Deze gids illustreert het proces van het laden van kettingen vanuit LangChain Hub.

Hoe kan ik een geheugenstatus in de keten toevoegen met behulp van LangChain?

De geheugenstatus kan worden gebruikt om de ketens te initialiseren, omdat deze kan verwijzen naar de recente waarde die is opgeslagen in de ketens en die zal worden gebruikt bij het retourneren van de uitvoer. Om het proces te leren van het toevoegen van een geheugenstatus in ketens met behulp van het LangChain-framework, volgt u eenvoudigweg deze eenvoudige handleiding:

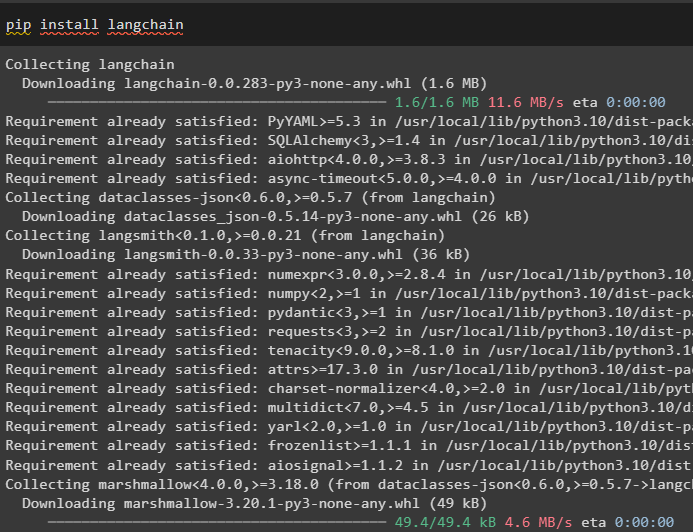

Stap 1: Modules installeren

Stap eerst in het proces door het LangChain-framework met zijn afhankelijkheden te installeren met behulp van de pip-opdracht:

pip installeer langchain

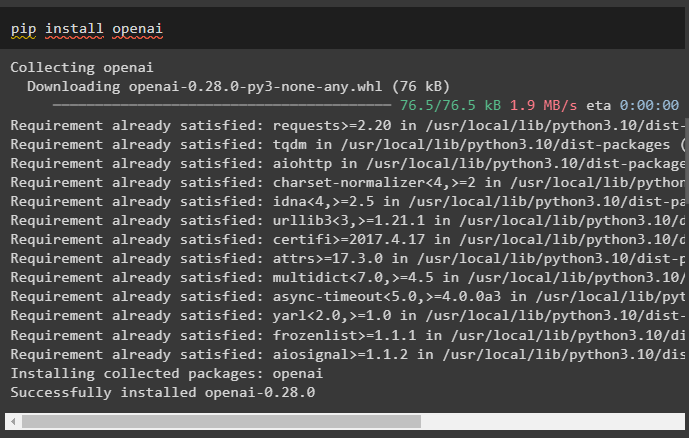

Installeer ook de OpenAI-module om de bibliotheken te verkrijgen die kunnen worden gebruikt om de geheugenstatus aan de keten toe te voegen:

pip installeer openai

Haal de API-sleutel op van het OpenAI-account en de omgeving opzetten het gebruiken zodat de ketens er toegang toe hebben:

importeren Jij

importeren Krijg een pas

Jij . ongeveer [ 'OPENAI_API_KEY' ] = Krijg een pas . Krijg een pas ( 'OpenAI API-sleutel:' )

Deze stap is belangrijk om de code goed te laten werken.

Stap 2: Bibliotheken importeren

Na het instellen van de omgeving importeert u eenvoudigweg de bibliotheken voor het toevoegen van de geheugenstatus, zoals LLMChain, ConversationBufferMemory en nog veel meer:

van langketen. kettingen importeren ConversatieKetenvan langketen. geheugen importeren ConversatieBufferGeheugen

van langketen. chat_modellen importeren ChatOpenAI

van langketen. kettingen . llm importeren LLMChain

van langketen. aanwijzingen importeren Promptsjabloon

Stap 3: ketens bouwen

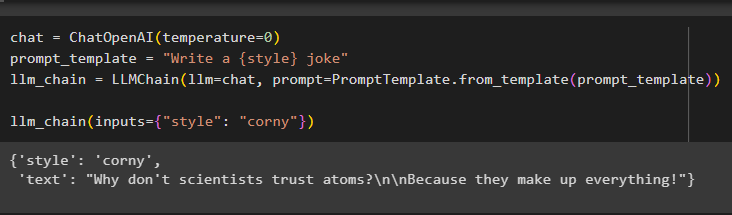

Bouw nu eenvoudig ketens voor de LLM met behulp van de OpenAI()-methode en het sjabloon van de prompt met behulp van de query om de keten aan te roepen:

chatten = ChatOpenAI ( temperatuur = 0 )prompt_sjabloon = 'Schrijf een {style} grap'

llm_chain = LLMChain ( llm = chatten , snel = Promptsjabloon. Van sjabloon ( prompt_sjabloon ) )

llm_chain ( ingangen = { 'stijl' : 'smakeloos' } )

Het model heeft de uitvoer weergegeven met behulp van het LLM-model, zoals weergegeven in de onderstaande schermafbeelding:

Stap 4: Geheugenstatus toevoegen

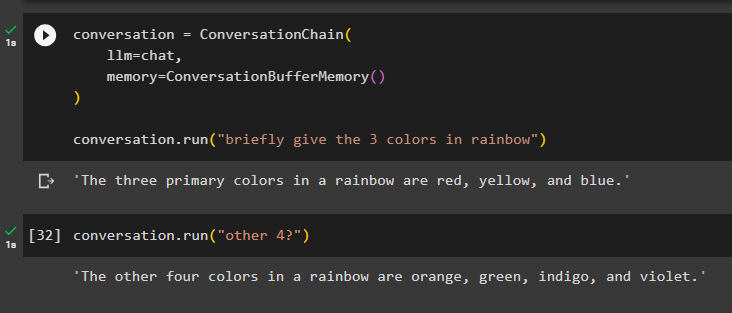

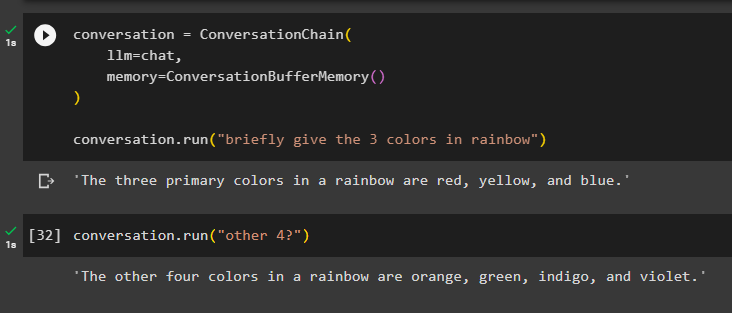

Hier gaan we de geheugenstatus in de keten toevoegen met behulp van de ConversationBufferMemory() methode en de keten uitvoeren om 3 kleuren uit de regenboog te halen:

gesprek = ConversatieKeten (llm = chatten ,

geheugen = ConversatieBufferGeheugen ( )

)

gesprek. loop ( 'Geef kort de 3 kleuren van de regenboog' )

Het model heeft slechts drie kleuren van de regenboog weergegeven en de context is opgeslagen in het geheugen van de keten:

Hier voeren we de keten uit met een dubbelzinnig commando als “ andere 4? ” dus het model haalt zelf de context uit het geheugen en geeft de resterende regenboogkleuren weer:

gesprek. loop ( 'andere 4?' )Het model heeft precies dat gedaan, omdat het de context begreep en de overige vier kleuren uit de regenboogset teruggaf:

Dat draait allemaal om laadkettingen van LangChain Hub.

Conclusie

Om het geheugen in ketens toe te voegen met behulp van het LangChain-framework, installeert u eenvoudigweg modules om de omgeving voor het bouwen van de LLM in te stellen. Importeer daarna de bibliotheken die nodig zijn om de ketens in de LLM te bouwen en voeg vervolgens de geheugenstatus eraan toe. Nadat u de geheugenstatus aan de keten hebt toegevoegd, geeft u eenvoudigweg een opdracht aan de keten om de uitvoer op te halen en geeft u vervolgens een andere opdracht binnen de context van de vorige om het juiste antwoord te krijgen. In dit bericht wordt dieper ingegaan op het proces van het toevoegen van een geheugenstatus in ketens met behulp van het LangChain-framework.