Syntaxis:

Omdat we bekend zijn met ChatGPT, weten we dat dit platform eigendom is van de Open AI-gemeenschap en dat het tools, architecturen, API's en verschillende frameworks biedt die we kunnen gebruiken bij de implementatie van onze applicaties en de modellen voor natuurlijke taalverwerking. Open AI biedt de API's waarmee we alle vooraf getrainde AI- en NLP-modellen van het Open AI-platform kunnen gebruiken en kunnen laten werken voor onze applicaties, bijvoorbeeld om voorspellingen te doen over realtime gegevens. Evenzo biedt GPT4All zijn gebruikers ook de mogelijkheid om zijn vooraf getrainde AI-modellen te integreren met verschillende applicaties.

Het GPT4All-model is getraind op beperkte gegevens in vergelijking met ChatGPT. Het heeft ook enkele van zijn prestatiebeperkingen in vergelijking met ChatGPT, maar het stelt de gebruiker in staat om zijn privé-GPT op zijn lokale hardware te gebruiken en er zijn geen netwerkverbindingen voor nodig. Met behulp van dit artikel zullen we leren hoe we de GPT4All-modellen in Python-script kunnen gebruiken, aangezien GPT4All de officiële bindingen met Python heeft, wat betekent dat we de GPT4All-modellen ook via Python-script kunnen gebruiken en integreren.

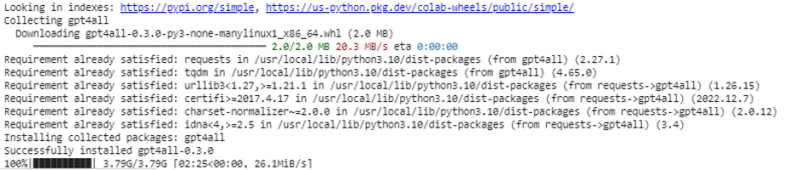

Er is allemaal een online opdracht nodig om de GPT4All voor de Python IDE te installeren. Dan kunnen we net zoveel AI-modellen integreren als onze applicaties. De opdracht om dit de GPT4All in Python te installeren is zoals hieronder getoond:

$ pip gpt4all installeren

Voorbeeld 1:

Om met dit voorbeeld aan de slag te gaan, moeten we Python downloaden en installeren in onze systemen. De aanbevolen versies van Python zijn 'versie 3.7' of degene die na deze versie kwamen. Een andere manier om met Python te werken om het lange proces van het installeren van de 'Python-installatie' op onze systemen te vermijden, is door 'Google Colab' te gebruiken, een cloudgebaseerde omgeving voor Python. We kunnen deze omgeving op elke webbrowser uitvoeren en de AI- en machine learning-modellen bouwen. De voorbeelden die we hier zullen implementeren, worden uitgevoerd in Google Colab.

Dit voorbeeld behandelt de methode om de GPT4All in Python te installeren en hoe de vooraf getrainde modellen te gebruiken. We beginnen met eerst de GPT4All te installeren. Daarvoor wordt de opdracht die we eerder noemden uitgevoerd. Met de uitvoering van de opdracht wordt de GPT4All samen met zijn pakketten en frameworks gedownload en geïnstalleerd.

Nu gaan we vooruit. Vanuit GPT4All importeren we de “GPT4All”. Dit voegt alle vooraf getrainde modellen uit de GPT4All toe aan het project. Nu kunnen we elk model gebruiken en het de voorspellingen voor onze toepassing laten doen. Nadat we het GPT4All-pakket hebben geïmporteerd, is het nu tijd om deze functie aan te roepen en het GPT4All-model te gebruiken dat de uitvoer geeft voor de 'chatvoltooiing'.

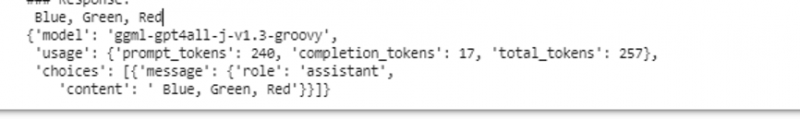

Met andere woorden, als we iets van dat model vragen in de invoer, geeft het dit terug in de uitvoer. Het model dat we hier gebruiken is 'ggml-gpt4all-j-v1.3-groovy'. Deze modellen zijn al opgeslagen in de GPT4All-cache. We kunnen deze modellen van deze link krijgen ' https://github.com/nomic-ai/gpt4all/tree/main/gpt4all-chat ” voor handmatig downloaden. Als het model al aanwezig is in de GPT4All-cache, noemen we gewoon de naam van het model en specificeren we het als invoerparameters voor de functie 'GPT4All()'. Als we het handmatig hebben gedownload, geven we het pad door naar de map waar het model zich bevindt. Aangezien dit model bedoeld is voor het voltooien van berichten, wordt de syntaxis voor dit model als volgt gegeven:

$ Chat_completion (berichten)De berichten zijn een woordenboeklijst en elk woordenboek moet een 'rol'-sleutel bevatten met een waarde van de gebruiker, het systeem of de assistent, en de 'sleutel'-inhoud die de waarde heeft als tekenreeks. In dit voorbeeld specificeren we de inhoud als 'noem drie kleuren' en de rolsleutel als 'gebruiker'.

$model= GPT4All('ggml-gpt4all-j-v1.3-groovy')$messages = [{'rol': 'gebruiker', 'inhoud': 'Naam 3 bloemen'}]

Na deze specificatie noemen we de functie 'chat_completion()' bij het model. De code hiervoor wordt weergegeven in de volgende uitvoer:

$ !pip gpt4all installerenvan gpt4all importeer GPT4All

model = GPT4All('ggml-gpt4all-j-v1.3-groovy')

messages = [{'rol': 'gebruiker', 'content': 'Noem drie kleuren'}]

model.chat_completion(berichten)

Na de uitvoering van dit voorbeeld retourneert het model drie kleuren als reactie op de invoer.

Voorbeeld 2:

We behandelen nog een voorbeeld waarin we een andere methode ontdekken om de GPT4All in Python te gebruiken. Dit kan worden gedaan met behulp van de officiële bindingen voor de Python die wordt geleverd door 'Nomic', een open-source AI-gemeenschap, en het voert de GPT4All uit. Met behulp van de volgende opdracht integreren we 'nomic' in onze Python-console:

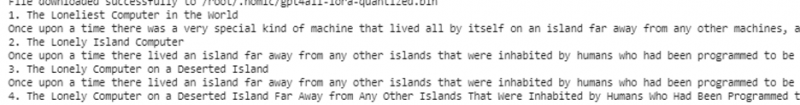

$ pip install nomischZodra dit is geïnstalleerd, importeren we de GPT4All uit 'nomic.gpt4all'. Na het importeren van GPT4All initialiseren we de GPT4All met de functie 'open()'. Vervolgens noemen we de functie 'prompt()' en geven we een prompt door aan deze functie. Vervolgens wordt een promptantwoord gegenereerd op basis van de prompt die we hebben gegeven als invoer voor het promptmodel.

!pip installeer nomicvan nomic.gpt4all importeer GPT4All

# Initialiseer het GPT4All-model

initiëren = GPT4All()

initiëren.open()

# Een reactie genereren op basis van de prompt

model_response = initiëren.prompt('schrijf een kort verhaal over een computer)

# het gegenereerde antwoord weergeven

print(model_antwoord)

De uitvoer toont de snelle reactie van het model dat we hebben gegenereerd met behulp van het vooraf getrainde GPT4All-model in Python. Als we meer willen weten over de modellen en hoe we deze modellen kunnen gebruiken om de antwoorden te genereren, of in eenvoudige bewoordingen, als we kennis willen opdoen over de syntaxis om de antwoorden van deze modellen te genereren, kunnen we verdere hulp krijgen van de GPT4Alle details van de technische documentatie.

Conclusie

GPT4All streeft nog steeds naar prestatienauwkeurigheid. Het wordt gerund door het nomic AI-platform dat tot doel heeft zijn gebruikers kunstmatig intelligente chatbots te bieden op CPU's van consumentenkwaliteit, aangezien GPT4All werkt zonder enige netwerkverbinding en GPU's. Dit artikel helpt ons om de PyGPT4All vakkundig te gebruiken in een Python-omgeving en om een interactie te creëren tussen onze applicaties en de vooraf getrainde GPT4All AI-modellen. In deze handleiding hebben we twee verschillende methoden besproken voor het installeren van GPT4All in Python.